Bruxelles – Per l’Atto Ue sull’intelligenza artificiale è il giorno più importante, quello che potrebbe vedere la nascita della prima legislazione al mondo in materia. Ma l’accordo tra i co-legislatori del Parlamento e del Consiglio dell’Ue non è così scontato, perché il possibile round finale di triloghi in programma oggi pomeriggio (6 dicembre) potrebbe ancora incagliarsi su alcuni ostacoli che la stessa presidenza di turno spagnola del Consiglio dell’Ue sta cercando di superare. “Abbiamo allineato le nostre posizioni e abbiamo sufficiente flessibilità per discutere con il Parlamento“, ha assicurato la segretaria di Stato spagnola per la Digitalizzazione e l’intelligenza artificiale e presidente di turno del Consiglio dell’Ue, Carme Artigas, intervenendo ieri (5 dicembre) alla riunione dei ministri Ue responsabili per le Telecomunicazioni.

“L’importante è raggiungere un accordo politico”, ha ribadito Artigas, mettendo in chiaro che – anche se oggi si troverà la quadra tra i negoziatori delle sue istituzioni comunitarie – bisognerà continuare il lavoro a livello tecnico per finalizzare il Regolamento entro la fine della legislatura nella primavera del prossimo anno. Al momento ci sono tre capitoli cruciali su cui serve un lavoro di mediazione intenso: norme di classificazione per i sistemi ‘ad alto rischio’, applicazione della legge e modelli generativi di intelligenza artificiale. Il vero ostacolo è proprio l’ultimo dei tre, considerato il fatto che Francia, Germania e Italia da settimane non sostengono l’approccio graduale della presidenza spagnola sulla questione dei modelli di fondazione (un tipo di intelligenza artificiale generativa addestrata su un ampio spettro di dati generalizzati e senza etichette), chiedendo codici di condotta per lo sviluppo di questi modelli.

In attesa dell’ultimazione dei triloghi, le istituzioni comunitarie sono però coscienti del fatto che, mentre alcune disposizioni si applicheranno poco dopo l’adozione del Regolamento, altre saranno applicabili solo al termine di un periodo transitorio, come i requisiti sui sistemi di intelligenza artificiale ad alto rischio. È così che è stato lanciato il Patto sull’Ia lo scorso 16 novembre, per cercare di spingere l’impegno volontario dell’industria per iniziare ad attuarne i requisiti prima della scadenza legale, soprattutto per quanto riguarda i sistemi di Ia generativa in vista delle elezioni europee del giugno del prossimo anno. In questo contesto le aziende che aderiranno sigleranno delle dichiarazioni di impegno, accompagnate da azioni concrete in corso o pianificate che la Commissione Ue pubblicherà per dare visibilità e creare ulteriore fiducia. Al momento è stato lanciato l’invito a manifestare interesse, prima delle discussioni (previste nella prima metà del 2024) tra le parti interessate sulle idee preliminari e le buone pratiche. Dopo l’adozione formale dell’Atto sull’intelligenza artificiale, le organizzazioni leader del Patto saranno invitate a rendere pubblici i loro primi impegni.

Le basi del Regolamento Ue sull’intelligenza artificiale

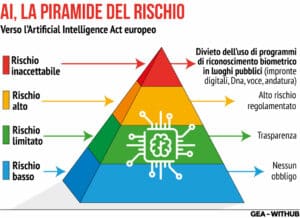

È del 21 aprile del 2021 la proposta di un quadro normativo sull’intelligenza artificiale presentata dalla Commissione Europea per lo sviluppo e l’utilizzo di tecnologie all’avanguardia sul suolo dell’Ue. Si tratta della prima iniziativa legislativa al mondo per definire un approccio normativo sui sistemi di Ia. Sia il Consiglio sia il Parlamento Europeo hanno deciso di dare seguito all’impostazione presentata dall’esecutivo e ciò che emergerà – al netto di aggiustamenti per far convergere le posizioni delle due istituzioni – sarà una scala di rischio per regolamentare le applicazioni di intelligenza artificiale su quattro livelli: minimo (videogiochi abilitati per l’Ia e filtri anti-spam), limitato (chatbot), alto (assegnazione di punteggi a esami scolastici e professionali, smistamento dei curriculum, valutazione dell’affidabilità delle prove in tribunale, chirurgia assistita da robot) e inaccettabile (tutto ciò che rappresenta una “chiara minaccia” per la sicurezza, i mezzi di sussistenza e i diritti delle persone, come l’assegnazione di un ‘punteggio sociale’ da parte dei governi).

Per il primo livello non è previsto alcun intervento, mentre l’ultimo livello sarà vietato integralmente. I sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si sta giocando sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori- sulla spinta degli eurodeputati– sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) esoftware di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Per il primo livello non è previsto alcun intervento, mentre l’ultimo livello sarà vietato integralmente. I sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si sta giocando sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori- sulla spinta degli eurodeputati– sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) esoftware di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Infine, come ricordato al summit internazionale nel Regno Unito dalla presidente della Commissione Ue, Ursula von der Leyen, all’interno della proposta di Regolamento Ue sull’Ia c’è anche la possibilità di creare un Ufficio europeo per l’intelligenza artificiale. “Questo Ufficio potrebbe occuparsi dei modelli di Ia più avanzati, con la responsabilità della supervisione”, ha spiegato la numero uno dell’esecutivo comunitario, precisando che dovrebbe seguire i quattro principi delineati nel suo discorso sul quadro di governance globale e far rispettare le regole comuni in tutti i 27 Stati membri per i modelli più avanzati. Dalle parole di von der Leyen è emerso che l’Ufficio Ue per l’intelligenza artificiale “dovrebbe avere anche una vocazione globale“, collaborando con enti simili in tutto il mondo.